专家:担心“帅哥美女”用于邪恶目的

本文转自:中国科学报

作者 |徐锐

文章图片

文章图片

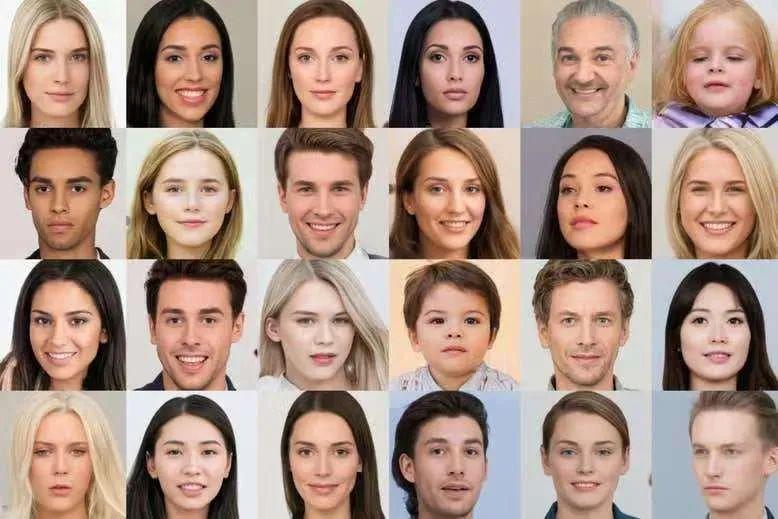

人工智能生成的假脸图片来源:Anatolii Babii / Alamy

近日 , 一项发表于美国《国家科学院院刊》的研究指出 , 如今 , 人工智能塑造的人脸逼真到能够以假乱真 , 让人很难区分 , 甚至人们更信任这些“假脸” 。

计算机生成的虚拟人脸非常有说服力 , 甚至可以愚弄那些训练有素的观察者 。这些虚拟人脸很容易在网上下载 , 并被用于网络诈骗和伪造社交媒体档案 。

“我们应该为此感到担忧 , 因为这些合成的面孔在达成一些邪恶目的 , 比如色情报复或欺诈方面非常有效 。”英国兰开斯特大学的Sophie Nattingale说 。

人工智能程序通过生成式对抗网络(GANs) , 学会创建与真实图像越来越难以区分的假图像 。

Nattingale和美国加利福尼亚大学的Hany Farid招募了315名未经培训和219名受训的试验参与者 , 看他们能否将400张假人与400张真人照片区分开 。研究人员又要求另外223名参与者对同一组面孔的可信度进行评分 , 评分范围为1到7分 。

研究人员发现 , 未经培训的参与者对照片的判断初始准确率为48.2%;接受过计算机生成人脸识别培训的参与者对照片判断的准确率为59% 。此外 , 参与者对人工合成面孔的信任度平均比真实面孔的信任度高8% 。其中排在最不值得信任的脸的前4张都是真人照片 , 而最值得信任的脸的前3张都是合成的假人照片 。

Nattingale指出 , 这可能是因为合成人脸看起来更像“普通”人 , 而人们更倾向于信任这种典型面孔 。

“我们需要建立更严格的道德准则和法律框架 , 因为不可避免地会有人想利用(这些图像)对他人造成伤害 , 这令人担忧 。”Nattingale指出 , 为了降低这一风险 , 开发者可以在他们制作的合成图像上添加水印 , 表明其为虚拟图片 。

“在我看来 , 目前情况已经够糟糕的了 。如果我们再不采取措施进行约束 , 情况只会更糟 。”Nattingale说 。

相关论文信息:

https://doi.org/10.1073/pnas.2120481119

《中国科学报》 (2022-02-16 第2版 国际 黑龙江龙网_原标题为《“以假乱真”的AI合成脸更易获得信任》)

【专家:担心“帅哥美女”用于邪恶目的】编辑 | 赵路

- “冬奥+绿色”:北京冬奥看台座椅,潜藏深企创新科技玄妙

- 第六代柔性屏实现“厦门造” 国内单体最大

- 蚂蚁新村每日答案|陶瓷版“冰墩墩”和“雪容融”产自哪里(蚂蚁新村2月16日答案)

- iPhone 6 Plus被列入苹果的“复古产品”清单

- 北京成功摘“星”!

- 助力冬奥会!这家企业运用“黑科技”提升视听体验

- NASA公布X射线“眼睛”探得的首批照片

- 为北京冬奥冰雪五环贡献“惠州力量”

- 金山这里汇集了“三个超市”,助力营造良好营商环境

- 揭秘冬奥会同声传译 做“翻译界的皇冠”有多难?